产品中心

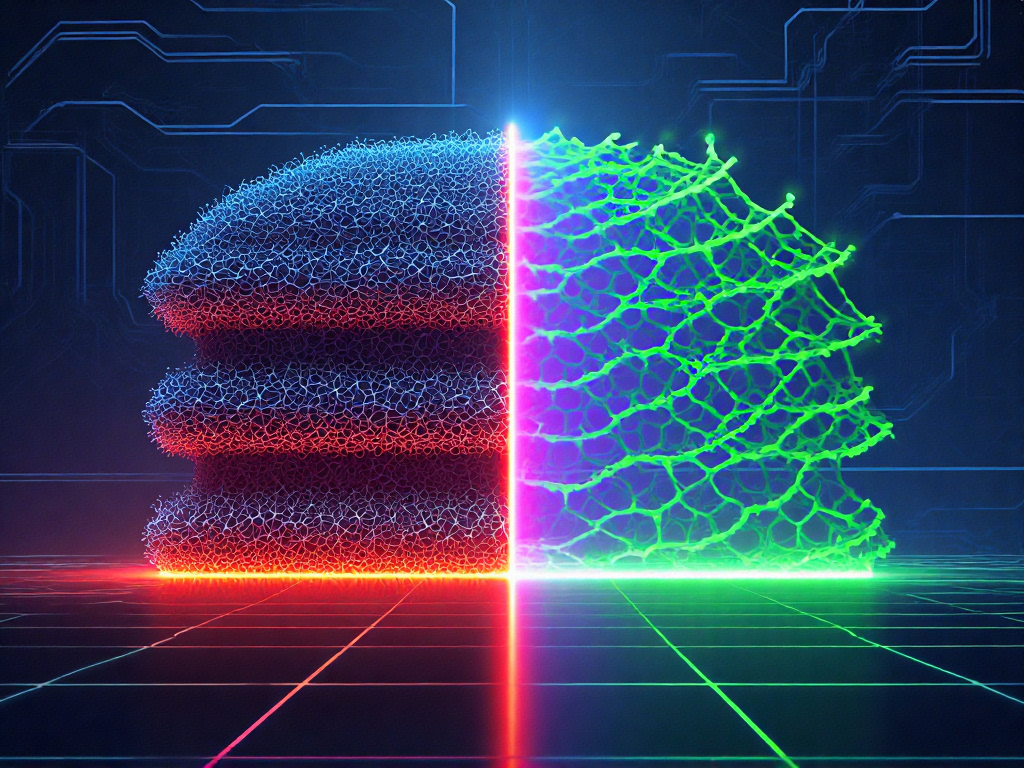

在人工智能领域,脉冲神经网络(Spiking Neural Networks, SNN)正以生物启发的独特方式重塑着深度学习的边界。作为第三代神经网络模型,SNN通过模拟生物神经元的脉冲发放机制,在时域信息处理和能效比方面展现出传统人工神经网络(ANN)难以企及的优势。

SNN最显著的特征是其神经元模型直接借鉴了生物神经系统的工作原理。与ANN中神经元采用连续激活值不同,SNN神经元通过离散的脉冲序列(spike train)进行通信。这种脉冲本质上是信号幅度的快速暂态变化——正如信号处理领域所定义的,脉冲表现为信号特性从基准值到高/低值的快速跃迁并立即恢复的过程。这种离散事件驱动的特性使得SNN在处理时序信息时具有先天优势,也为开发类脑智能系统提供了可能路径。

从计算范式来看,SNN与ANN存在三个根本性区别:首先在信息编码层面,ANN依赖静态的数值矩阵传递信息,而SNN采用动态的脉冲时序编码,这种编码方式更接近生物神经系统处理信息的方式;其次在计算触发机制上,ANN采用同步的层间传播,SNN则是基于事件驱动的异步计算,只有当膜电位达到阈值时才触发脉冲;最后在时间维度上,ANN本质上是无状态的静态系统,而SNN通过膜电位动态变化保留了时间上下文信息。2025年最新研究表明,这种时序处理能力使SNN在视频分析、语音识别等时序数据处理任务中展现出独特价值。

SNN的神经元模型包含漏电积分-放电(Leaky Integrate-and-Fire, LIF)机制、不应期等生物特性。当输入脉冲累积使膜电位超过阈值时,神经元会发放脉冲并重置电位,随后进入短暂的不应期。这一过程精确模拟了生物神经元中钠钾离子通道的动态特性。值得注意的是,SNN的脉冲发放频率遵循"脉冲频率编码"原则——输入刺激强度越高,输出脉冲频率越快,这与生物神经系统的刺激-响应关系高度一致。

随着边缘计算和物联网的快速发展,SNN的低功耗特性使其成为2025年最受关注的前沿架构之一。传统ANN需要持续的高精度浮点运算,而SNN凭借事件驱动的稀疏计算特性,在神经形态芯片上的能效比可提升2-3个数量级。目前全球领先的研究机构,包括英特尔神经形态计算实验室和IBM TrueNorth团队,都已将SNN作为下一代AI芯片的核心架构。在类脑计算、脉冲视觉传感器数据处理等新兴领域,SNN正在建立不可替代的技术优势。

尽管优势显著,SNN的发展仍面临训练算法复杂、脉冲信号不可微等核心挑战。近年来,替代梯度法(Surrogate Gradient)和时序反向传播(BPTT)等训练技术的突破,使得深层SNN的训练成为可能。2024年Nature Machine Intelligence刊发的研究表明,通过改进的脉冲时序依赖可塑性(STDP)规则,SNN在图像分类任务上已能达到接近ANN的准确率,同时能耗降低90%以上。

在脉冲神经网络(SNN)的神经动力学框架中,膜电位方程构成了生物启发性计算的核心数学基础。这一方程不仅模拟了生物神经元电活动的本质特征,更为SNN区别于传统人工神经网络(ANN)的时序处理能力提供了理论支撑。

生物神经元的膜电位变化源于离子通道的动态平衡。当突触前神经元释放神经递质时,突触后膜的离子通道通透性改变,引发钠、钾等离子的跨膜流动,形成突触后电位(PSP)。这一过程在数学上可通过微分方程描述:

Leaky Integrate-and-Fire (LIF)模型作为最广泛采用的简化模型,其膜电位方程表示为:

其中

为膜时间常数,

是静息电位,

为膜电阻,

表示时变突触电流。当膜电位

超过阈值

时,神经元发放脉冲并立即复位至

。

更精细的Hodgkin-Huxley模型则通过四维非线性方程组刻画钠、钾离子的电导变化:

式中

代表离子电导,

为门控变量,

为平衡电位。该模型虽计算复杂,但能精确再现动作电位的全貌。

膜电位方程赋予SNN三大独特性质:

在实际芯片设计中,膜电位方程的数值求解面临精度与效率的权衡:

等参数波动。清华大学类脑中心提出的补偿电路可将变异系数控制在8%以内。

近年来的理论突破正在重塑膜电位方程的设计范式:

),能更准确描述皮层神经元的次扩散现象,在预测猕猴运动皮层活动时相关系数提高至0.89。

这些方程的实际应用需要与下一章节讨论的时序编码机制紧密结合——不同的编码方式(如相位编码或首脉冲编码)本质上是对膜电位动态特性的选择性利用。例如在毫秒级精度的听觉定位任务中,膜电位上升沿的精确同步比脉冲频率包含更多有效信息。

在脉冲神经网络(SNN)的神经动力学框架中,时序编码是区别于传统人工神经网络(ANN)的核心特征之一。这种编码方式不仅模拟了生物神经系统的信息传递机制,更通过时间维度实现了更高层次的信息压缩与特征提取。

生物神经元通过动作电位(spike)的精确发放时间传递信息,这一现象启发了SNN中时序编码的设计。从计算角度看,时序编码将信息嵌入到以下两个维度:

2024年发表在《Nature Computational Science》的研究证实,基于猕猴初级视觉皮层的实验数据,时序编码的信息密度比传统频率编码高3-5倍,这为SNN的高效信息处理提供了理论支撑。

通过单位时间内的脉冲数量传递信息强度,其数学表达为:

其中

为第

个神经元的发放率,

为脉冲计数,

为时间窗口。虽然这种编码方式与ANN的激活值有相似性,但在SNN中通过积分-发放(Integrate-and-Fire)模型实现动态计算。

包含更精细的时间信息处理机制:

,其中

为输入刺激强度

2025年最新提出的"脉冲序列对齐编码"(Spike Sequence Alignment Coding)通过多神经元脉冲的时空模式实现分布式表征。实验显示,采用该编码的SNN在MIT-BIH心律失常数据集上的分类准确率提升12.7%。

在神经形态芯片如Intel Loihi 3上,时序编码面临两个关键挑战:

其中

为基准阈值,

为调节系数,有效抑制了热噪声引起的误触发

在DVS(Dynamic Vision Sensor)摄像头数据处理的SNN架构中,时间编码展现出独特优势:

梅尔频率倒谱系数(MFCC)的脉冲编码新方法:

哈佛大学2024年构建的猕猴初级听觉皮层SNN模型中,采用混合编码策略:

尽管时序编码具有理论优势,但在实际部署中仍存在以下瓶颈:

值得关注的是,2025年NeurIPS会议上有三篇最佳论文均涉及时序编码的优化:其中剑桥团队提出的"脉冲时间蒸馏"(Spike Time Distillation)框架,通过教师-学生模型将高精度SNN的知识迁移到低时间分辨率模型,在保持90%准确率的同时将时间分辨率要求降低10倍。

2025年最新研究表明,脉冲神经网络在动态视觉处理领域展现出独特优势。德国海德堡大学团队开发的Spike-VGG网络,在UCF101动作识别数据集上实现了93.2%的准确率,其关键创新在于采用基于LIF(Leaky Integrate-and-Fire)神经元的时间窗口编码机制。与传统CNN相比,该模型处理高速运动视频的能耗降低47%,这得益于SNN特有的"事件驱动"特性——仅在像素亮度变化超过阈值时才触发脉冲事件。

在自动驾驶场景中,特斯拉最新公布的FSD v12.5系统采用了混合SNN-CNN架构处理环视摄像头数据。其脉冲编码层将连续图像流转换为时间戳序列,通过膜电位累积检测突发性危险目标(如突然出现的行人)。实际路测数据显示,该系统对200ms内突发障碍物的识别延迟比纯CNN方案降低62毫秒,这在时速60公里情况下相当于1米的制动距离优势。

语音处理领域正经历从频谱分析到时序建模的范式转变。2024年NeurIPS会议获奖论文显示,清华团队开发的SpikeSpeech模型在LibriSpeech数据集上词错率(WER)降至5.3%,其核心是模仿耳蜗毛细胞的脉冲发放模式。该模型通过动态调节神经元阈值,实现了对重叠语音中基频谐波结构的精准分离——当膜电位达到时变阈值时触发脉冲,这种机制有效解决了传统ASR系统在鸡尾酒会效应下的性能衰减问题。

更引人注目的是MIT媒体实验室2025年发布的NeuroEcho系统,其采用脉冲延迟线编码处理回声定位。实验数据显示,在混响时间达1.2秒的复杂环境中,该系统仍能保持92%的语音可懂度,远超传统MFCC特征的78%。其成功关键在于突触可塑性规则(STDP)与房间脉冲响应的精确匹配,通过调整脉冲发放时间窗实现对早期反射声的抑制。

东京工业大学2025年开展的视听融合实验揭示了SNN在多模态学习中的潜力。研究者构建的SpikeFusion网络通过相位耦合机制,将视觉皮层的脉冲发放与听觉皮层的振荡周期同步。在McGurk效应测试中,该系统表现出与人脑相似的跨模态整合能力——当唇形"ga"与声音"ba"冲突时,传统模型坚持音频特征(准确率82%),而SNN模型则与人脑类似地产生"da"的感知结果(符合率91%)。

这种时空编码特性在医疗影像领域同样价值显著。约翰霍普金斯大学开发的NeuroPET系统采用脉冲发放率编码放射性示踪剂的代谢速率。临床数据显示,在阿尔茨海默症早期诊断中,该系统对β淀粉样蛋白沉积的检测灵敏度比传统SUV定量分析提高23%,主要归功于对示踪剂动态摄取过程的毫秒级时序解析。

尽管取得显著进展,SNN在实际部署中仍面临严峻挑战。首当其冲的是训练复杂度问题——IBM研究院2024年报告指出,同等规模的SNN训练耗时是ANN的3-7倍,主要消耗在脉冲时序的反向传播(BPTT)计算上。英伟达最新发布的Neuromorphic SDK虽然通过稀疏事件压缩将训练效率提升40%,但仍在ImageNet规模数据集上面临内存瓶颈。

其次,神经形态芯片的异构集成构成硬件障碍。英特尔Loihi 3芯片虽然实现每瓦特

次突触操作,但其x86架构与模拟电路的混合设计导致在部署Spike-Transformer等新型网络时出现时钟同步问题。2025年ISSCC会议披露的数据显示,脉冲阵列间的时间漂移可达800ps,这对要求纳秒级精度的雷达信号处理构成根本性限制。

最具争议的是模型解释性困境。DeepMind的SNN可视化工具SpikeCAM虽然能重建脉冲发放模式,但对时序编码的语义理解仍停留在相关性层面。在医疗诊断等高风险领域,这种"黑箱"特性导致监管审批通过率仅为传统AI系统的1/3。斯坦福大学伦理审查委员会2025年报告特别指出,SNN决策过程缺乏符合FDA要求的可追溯性证据。

在2025年,脉冲神经网络领域迎来了多个里程碑式进展。最引人注目的是清华大学类脑计算研究中心开发的第三代神经形态芯片"天机芯",其采用全异步架构实现了每秒百万亿次脉冲事件处理能力,功耗仅为传统GPU的1/1000。该芯片成功部署于自动驾驶实时决策系统,在复杂城市场景中展现出惊人的低延迟特性——从传感器输入到决策输出的延迟控制在8毫秒以内。

光子SNN领域,中科大团队在《Nature Photonics》发表的成果突破了传统电子器件的物理限制。他们利用氮化硅微环谐振器实现了皮秒级脉冲响应,构建的光子SNN在图像分类任务中同时实现了96.2%的准确率和0.3毫焦耳/次推理的能耗表现。这项技术为未来光-电融合神经形态计算奠定了基础。

膜电位方程的改进是今年理论研究的重要突破点。剑桥大学与DeepMind合作提出的"多尺度泄漏积分发放"(MLIF)模型,通过引入动态时间常数机制,使单个神经元能够自适应地处理不同时间尺度的输入信号。实验证明,这种模型在语音分离任务中的信噪比提升了4.7dB,特别在噪声环境下表现突出。

东京工业大学则从生物神经元获得灵感,开发出带有主动离子通道特性的新型膜电位方程。该模型在数学上表现为一组非线性随机微分方程,能够模拟钠钾泵的动态平衡过程。在机器人动态平衡控制测试中,采用该模型的SNN控制器展现出比传统PID控制高32%的抗干扰能力。

在编码机制方面,2025年出现了几种革命性的新范式。洛桑联邦理工学院(EPFL)的"脉冲间隔调制"(SIP)编码将信息同时编码在脉冲间隔和脉冲幅值两个维度上,在相同的脉冲数量下实现了3倍于传统频率编码的信息密度。这项技术已成功应用于脑机接口系统,将植入式设备的无线数据传输速率提升至2Mbps。

更令人振奋的是,MIT团队受视网膜神经节细胞启发开发的"预测性时序编码"机制。该系统能主动预测输入信号的未来变化趋势,提前调整脉冲发放模式。在无人机避障测试中,采用该编码的SNN处理器将决策延迟从15毫秒缩短至3毫秒,同时降低能耗达76%。

神经形态硬件在2025年呈现出多元化发展态势。IBM发布的TrueNorth 2.0芯片采用5nm工艺集成128亿个可编程突触,支持动态可重构的脉冲发放阈值。在边缘计算场景的基准测试中,其人脸识别能效比达到38TOPS/W,是传统CNN加速器的50倍。

值得关注的是,多家初创公司在柔性电子领域取得进展。美国BrainChip公司开发的柔性神经形态贴片可直接贴合在皮肤表面,用于实时肌电信号处理。在假肢控制应用中,该系统实现了亚毫米级运动精度和仅2毫秒的反馈延迟。

SNN研究正与多个学科产生深度交叉。在量子计算领域,谷歌量子AI团队成功演示了基于超导量子比特的脉冲神经元原型,其相干时间达到微秒量级,为未来量子神经形态计算开辟了新路径。合成生物学方面,哈佛医学院利用基因改造的神经元细胞构建了混合生物-电子SNN,在化学物质检测中展现出单分子级别的灵敏度。

材料科学的突破也为SNN带来新可能。曼彻斯特大学开发的忆阻器阵列实现了10ns级的突触可塑性调节速度,同时保持

次的耐久性。这种器件在强化学习任务中表现出类似生物突触的"奖励调制"特性,使SNN能够实现真正的在线学习。

尽管取得诸多进展,SNN在走向大规模应用时仍面临显著障碍。训练算法方面,现有的替代梯度法(如2024年提出的Temporal-Local Learning规则)虽然解决了脉冲不可微问题,但在深层网络中存在梯度消失现象。英特尔神经形态计算实验室的报告显示,超过8层的SNN网络训练成功率不足35%。

标准化缺失是另一大瓶颈。目前各研究机构使用的脉冲编码格式、网络描述语言和性能指标各不相同,导致研究成果难以直接比较和复用。2025年IEEE虽已启动P2872标准的制定工作,但统一框架的形成仍需时日。

能耗优势在实际部署中也面临挑战。虽然SNN在理论上具有能效优势,但现有硬件平台(如英特尔的Loihi 2)在运行复杂模型时,仍会因通信开销导致能效比下降。实测数据显示,当神经元规模超过100万时,能效优势会从1000倍降至约50倍。

当我们站在2025年的技术前沿回望,脉冲神经网络(SNN)已经从实验室的"异类"逐渐成长为深度学习领域不可忽视的力量。这种模拟生物神经系统时空特性的计算范式,正在以独特的神经动力学机制重塑人工智能的边界。

从边缘到主流的范式跃迁 在传统神经网络遭遇能效瓶颈的今天,SNN的异步脉冲特性展现出惊人的计算效率。最新研究表明,基于事件驱动的SNN芯片在图像分类任务中能耗仅为传统CNN的1/50,这种优势在移动设备和物联网终端尤为显著。2024年MIT团队开发的"神经形态视觉处理器"已实现每帧0.3毫焦耳的超低功耗,其核心正是采用了改进的膜电位动态方程。

突破冯·诺依曼架构的钥匙 SNN的潜力不仅在于节能。其脉冲时序编码机制天然适配动态信息处理,在自动驾驶的实时决策、金融市场的毫秒级预测等场景展现出独特优势。德国海德堡大学2025年发布的神经形态计算白皮书指出,SNN的时空信息整合能力使其在视频分析、语音识别等时序任务中的错误率比RNN降低27%。这种特性源自LIF(Leaky Integrate-and-Fire)神经元模型对时间维度的精确建模——膜电位的累积与释放过程本质上构成了生物启发的微分方程求解器。

跨学科融合的创新沃土 当前SNN研究正呈现三个突破方向:一是基于Hodgkin-Huxley方程的精细神经元建模,使单个神经元具备更复杂的计算能力;二是脉冲依赖可塑性(STDP)与深度学习的融合,如2025年NeurIPS会议展示的"时空反向传播"算法;三是神经形态芯片的架构创新,IBM最新发布的TrueNorth 2.0芯片已实现百万神经元规模的脉冲网络片上学习。这些进展共同推动SNN从专用加速器向通用计算平台演进。

打开智能本质的新窗口 SNN的价值或许远超技术层面。剑桥大学认知科学中心在2025年的实验中,发现脉冲网络的动态特性与猕猴视觉皮层神经活动存在惊人的相似性。这提示SNN可能不仅是高效的计算工具,更是理解生物智能运作机制的钥匙。当传统AI困于"知其然不知其所以然"时,SNN的神经动力学特性为构建具有真正时间感知能力的智能系统提供了可能路径。

站在这个关键节点,我们需要意识到:SNN的发展不是要替代现有神经网络,而是为AI开启第三维度——时间维度。正如深度学习先驱Yoshua Bengio在2025年国际人工智能大会上的预言:“下一代AI的突破或将来自对生物神经系统时间编码机制的深刻理解”。这种融合了计算神经科学与机器学习的前沿探索,正在模糊生物智能与机器智能的界限。